¿Qué se necesita para crear la interfaz de usuario perfecta?

La tecnología avanza, y el tiempo que pasamos interactuando con las máquinas es cada vez mayor. El portal mediante el cual nos comunicamos con nuestra tecnología (la interfaz) mejora cada vez más.

En este artículo, se planteará el estado actual del desarrollo de interfaces y el futuro de nuestra comunicación con esta nueva forma de inteligencia. Está basado en lo que están desarrollando las más grandes empresas tecnológicas y en los datos de la conducta de los usuarios estos últimos años.

Fundamentalmente, una interfaz tiene que ser capaz de optimizar la comunicación entre los humanos y los sistemas digitales. Maximizando la cantidad de información relevante, intercambiada para alcanzar el objetivo del usuario.

La interfaz perfecta es entendida por el usuario de manera inmediata, y presenta una experiencia que satisface sus necesidades en el menor tiempo posible.

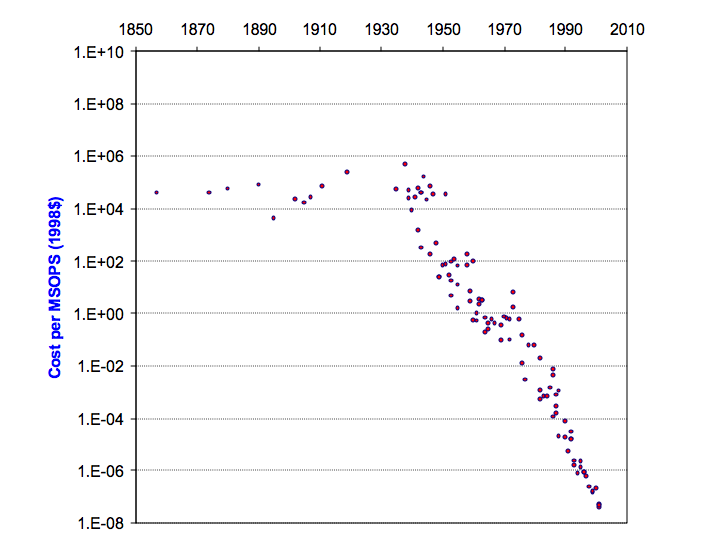

Una interfaz que cumpla el objetivo del usuario de manera óptima debe presentar una experiencia única en cada interacción. Gracias a la reducción de los costos computacionales y a la creación de nuevos algoritmos como el Reinforcement Learning with Human Feedback, nos acercamos más rápido que nunca a esta interfaz perfecta.

Generar un portal de comunicación optimo depende del avance en los siguientes tres componentes: inteligencia, ancho de banda y alineación de objetivos entre la inteligencia artificial y los humanos.

1. Incrementando el ancho de banda

El ancho de banda es factor clave en la búsqueda de la interacción perfecta, porque la cantidad de información que se intercambia es una variable directamente proporcional a la utilidad que el sistema puede otorgar. Actualmente el input de información más común es el texto, limitando nuestras capacidades de comunicación a la velocidad de nuestros pulgares.

Interfaces de texto

La tasa de información transmitida por un adulto promedio y una computadora es de aproximadamente 20 a 30 bits por segundo, escribiendo con un teléfono y de 33 a 67 escribiendo en una computadora . En contraste, un asistente de voz puede llegar hasta 100 bits por segundo. El punto de esta comparación es mostrar cómo a través del texto no se puede comunicar tanta información como con otras entradas y salidas.

Interfaces de Audio

Es importante no solo considerar la cantidad de bits, sino también cómo los humanos procesan y emiten la información. En el audio, con fluctuaciones en el tono de voz, los humanos comunican emociones que no están presentes en el texto, y en el video existe mucha información no verbal expresada a través del lenguaje corporal. Tanto el audio como el video comunican información compleja que el texto es incapaz de transmitir.

Actualmente, las interfaces de voz están incrementando en usuarios. Dispositivos como Amazon ‘s Alexa, Google’ s Assistant y Apple ‘s Siri, han demostrado ser pioneros en este campo, el uso de la interfaz de voz. Las interfaces de voz se han extendido a la industria automotriz. Empresas como BMW, Tesla y Mercedes adoptando esta tecnología para facilitar la interacción al conducir.

Para dimensionar la magnitud de la adopción de interfaces multimodales es importante saber que más de 100 millones de Amazon Alexas se han vendido. Está disponible en 60,000 dispositivos y conectado a más de 1 millón. El mercado en 2024 de Smart Speakers es superior a los 30 mil millones de dólares.

Fuentes: (Pop Sci, Globe Newswire, Venture Beat, Forbes, The Verge, Bloomberg, Statista, Science Direct, Insider, Tech Crunch, Global Market Insights).

De acuerdo con Google en (2018) Gradualmente está incrementando la adopción de audio y video. El 27% de la población mundial está usando voice search en su celular y el 72% de las personas que tienen un altavoz que se activa con voz lo utilizan como parte de su rutina diaria.

Realidad Virtual

Las nuevas interfaces de realidad virtual (VR) y realidad aumentada, también están ampliando el ancho de banda. Implementando el uso de cámaras en los visores para interactuar a través de información visual, creando una experiencia inmersiva.

La creación de estas interfaces, involucra el desarrollo de los sensores de captación de datos que ya comienzan a ser una rica fuente de datos para los algoritmos de aprendizaje de máquina. Ya se están implementando estos datos en el entrenamiento de modelos que antes eran únicamente de texto, utilizando redes neuronales convolucionales.

Los modelos LLMs ya están incorporando otras entradas de datos además de texto para tener una comprensión más completa de la realidad. El costo computacional está bajando rápidamente, y la tecnología de los sensores cada vez es mejor, haciendo posible esta realidad.

Antes solo existían los datos de cuánto tiempo el usuario pasa en cada página o con que botones interactúa. Ahora existen los datos de las expresiones faciales, los movimientos oculares y el tono de voz de los usuarios. Los LLMs más poderosos del momento se quedarán muy cortos con las capacidades de un modelo de aprendizaje de máquina entrenado con esos datos.

Interfaces Cerebrales

Está claro que las nuevas interfaces, van a potencializar la inteligencia de los modelos computacionales, pero ¿Cuál es la última frontera?.

Utilizando principios físicos fundamentales, la manera más directa de comunicarnos con las máquinas es a través de nuestras señales biológicas. No solo los movimientos que hacemos y el audio que emitimos. Sino las reacciones bioquímicas que ocurren en nuestro cerebro.

Ahora existen relojes inteligentes, que miden nuestra frecuencia cardiaca, saturación de oxígeno en sangre y presión arterial. Son muy útiles para prevenir múltiples enfermedades, identificando patrones en esos datos.

Sin embargo, es extremadamente importante recalcar que YA EXISTE un ser humano con un implante de Neuralink que es capaz de jugar ajedrez solo pensando. Neuralink no es la única ni la primera organización que crea interfaces cerebro computador, pero es un buen ejemplo para remarcar el avance que se está teniendo en esta área. Elon Musk aspira a aumentar el ancho de banda entre humanos y computadoras en más de 1000 veces.

El primer ingrediente para construir una interfaz perfecta es incrementar la comunicación. Esto es esencial para obtener los siguientes dos componentes que son, más inteligencia y alineamiento de esta inteligencia con los objetivos humanos.

2. Interfaces inteligentes

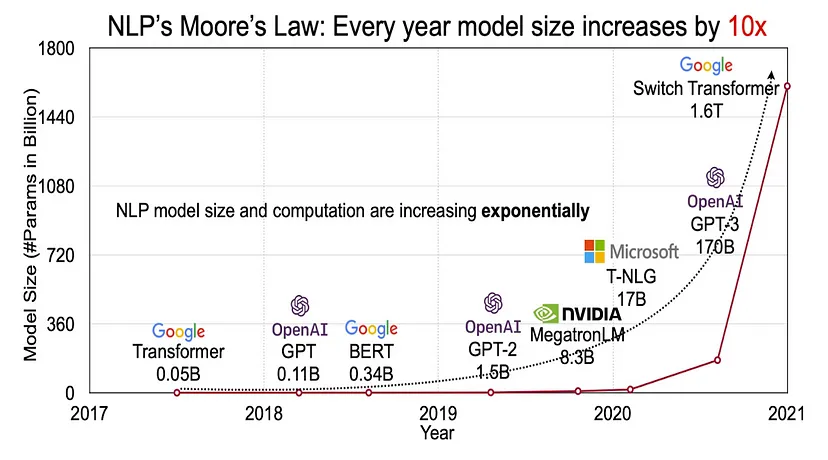

Las nuevas interfaces están trayendo más entradas de datos que nunca. Un gran reto para la humanidad, es construir software capaz de sacar el máximo provecho de estos datos para facilitar la comunicación y cumplir los objetivos humanos de la mejor manera.

Solo usando grandes cantidades de texto se han construido modelos muy inteligentes. Usar más tipos de datos de manera simultánea es una tarea compleja. No solo por la infraestructura necesaria para obtener, limpiar y pre-procesar esos datos, sino por el diseño de los algoritmos necesarios para procesar estos datos multimodales de manera eficiente y efectiva. Algo que le ha tomado a los organismos biológicos millones de años.

Los modelos de aprendizaje de máquina multimodales permitirán generar salidas en formatos de video y audio. Aunque GPT-4 aún se basa en texto y permite realizar conversaciones, no incorpora directamente el manejo de audio y video. Dado que el algoritmo no es de código abierto, no podemos confirmar si convierte el audio de las interacciones en texto antes de responder, ni si utiliza redes neuronales convolucionales para analizar las fluctuaciones de volumen de la voz durante las conversaciones. Sin embargo, dada la calidad del producto y el equipo de desarrollo, no sería descabellado pensar que podrían estar implementando estas características.

Las interfaces inteligentes se pueden crear a partir de los datos visuales y auditivos que actualmente se están recopilando. Para dar como respuesta, imagen y video personalizado en cada situación, modificando la información visual, auditiva y textual emitida por los usuarios en tiempo real, basándose en los datos generados a lo largo de toda la historia de interacción.

Incrementar la inteligencia de nuestras interfaces permitirá cumplir los objetivos del usuario en la menor cantidad de tiempo posible, con un sistema capaz de reconocer emociones e intenciones sin tener que comunicarlas en forma de lenguaje.

Solo falta un ingrediente, el alineamiento: las interfaces deben ser capaces de alinearse con los objetivos humanos. Es indispensable para la supervivencia humana que los objetivos de sistemas con este nivel de inteligencia estén alineados con los nuestros.

Estas correcciones mejorarán la claridad y la precisión del texto, haciéndolo más profesional y fácil de entender.

3. Alineando los objetivos

Alineación conlleva la capacidad de las máquinas de entender, anticipar y adaptarse a las necesidades y conductas humanas. Hacer que sistemas más inteligentes que nosotros busquen cumplir nuestras necesidades no es una tarea sencilla ni que se tiene que dar por hecho. Alcanzar alineamiento específicamente en la interfaz, es necesario para tener un funcionamiento intuitivo y funcional.

El alineamiento incrementa la satisfacción y creatividad productividad de estos. Un buen alineamiento reduce la curva de aprendizaje de nuevas tecnologías y minimiza los errores de comunicación entre el usuario y el sistema.

Los avances necesarios en inteligencia artificial para mejorar el alineamiento se hacen a partir de los datos de interacción del usuario, permitiendo predecir y adaptar estas interfaces a las preferencias del usuario.

Ejemplos de aplicaciones de un buen alineamiento; en la educación el aprendizaje personalizado puede incrementar significativamente el interés y la velocidad en la que los humanos aprenden. En el sector salud, herramientas de diagnóstico pueden ser utilizadas para mejorar los procesos de diagnóstico e incluso de intervención.

Actualmente se utiliza Deep Reinforcement Learning with Human Feedback (RLHF), un algoritmo que permite que los humanos le den retroalimentación a las decisiones que toma una máquina. En forma de correcciones, preferencias o en el cambio de las recompensas que recibe para incrementar o disminuir una acción.

Esto le permite al modelo no solo realizar su función de manera eficiente, sino que alinear sus acciones con los objetivos humanos. El alineamiento de objetivos es el último componente de la receta porque a pesar de la existencia de sistemas extremadamente inteligentes y una comunicación veloz con estos, de nada sirve si las metas de las máquinas son diferentes a la satisfacción de nuestras necesidades humanas.

Un futuro más allá de lo que podemos imaginar

En conclusión el futuro de las interfaces se determinará por el incremento en el ancho de banda que tiene la comunicación entre humanos y máquinas, para recolectar cantidades de datos previamente inimaginables, y así conseguir inteligencia artificial muchos órdenes de magnitud superior a la humana. Para evitar que ésta se salga de control, es necesario continuar con el desarrollo de algoritmos que mantengan el alineamiento en los objetivos de esa inteligencia sobrehumana.

Las interfaces inteligentes nos permitirán satisfacer nuestras necesidades fácil y rápidamente. El futuro de nuestras interacciones con máquinas será definido por algoritmos que no solo procesan palabras, también procesan nuestras voces y gestos, entendiendo nuestros deseos más profundos y nuestras necesidades inexpresadas. Por esta razón el alineamiento en objetivos es fundamental para estar seguros que las tecnologías emergentes amplifican nuestras capacidades de resolver problemas complejos, mejoran nuestra calidad de vida y sobrepasan nuestras fronteras de conocimiento, en lugar de dejar a nuestra especie atrás.

Por otro lado. Las tecnologías en crecimiento acelerado, como las interfaces cerebro-computadora, prometen un futuro donde la línea entre la intención humana y la respuesta computacional se vuelve más borrosa. A medida que esta tecnología madura seremos capaces de personalizar las interfaces para mejorar la experiencia de usuario, creando una nueva era en la relación entre humanos y computadoras.

Término el artículo con un recordatorio: Para que un mensaje sea entendido tal y cómo el emisor lo entiende, el receptor tiene que ser igual al emisor. La única manera de alcanzar una comunicación perfecta es convirtiendo al receptor en el emisor.

Referencias

Think with Google. (2020). Estadísticas de uso móvil y búsqueda por voz. https://www.thinkwithgoogle.com/

Yaguara. (2023). Estadísticas de búsqueda por voz: el futuro de la búsqueda en 2023. https://www.yaguara.co/

Gminsights. (2023). Mercado de altavoces inteligentes: tendencias de crecimiento, análisis de participación de mercado y pronóstico para 2028. https://www.linkedin.com/pulse/smart-speaker-market-insights-future-industry-sk12c

Datalab, Harish. (2022). Descubriendo el poder de los modelos de lenguaje grande (LLM). https://medium.com/@mestiri.sa/unveiling-the-power-of-large-language-models-the-basics-d171c47f2223

Zhu, H., Zhao, Y., Li, M., Yang, B., & Liu, J. (2023). A Survey of Mobile Sensing for Human Activity Recognition. Sensors, 23(2), 220. https://www.ncbi.nlm.nih.gov/pmc/articles/PMC10543321/

Lecun, Y. (2024, Marzo). Yann Lecun: Meta AI, Open Source, Limits of LLMs, AGI & the Future of AI [Podcast]. Lex Fridman Podcast #416. https://www.youtube.com/watch?v=5t1vTLU7s40

Deja un comentario